几乎所有客户都会问一个问题,为什么词元(Token)这么贵?

从 GPU 电费到企业AI模型Token账单,中间多加的价太多。调用方花了 1 块,真正落到算力上可能只剩三毛。剩下那七毛,分给了"集采的中间商"、"模型托管的中间商"、"再分销的中间商"。

企业要获得相同质量、更低成本的AI能力,首先要选对供应商。

无界模型云,对用户来说提供的同样是开源前沿大模型的API接口,背后其实是一张”不赚差价“的分布式词元算力网,在相同质量下把推理成本做到比大型云厂商更低。

一套 API,接齐主流模型

用无界模型云几乎不用改代码,开通后把 baseURL 换成无界的地址,就能享受更低成本的 Token,目前支持的模型有:

- 大语言模型:MiniMax 2.7、Qwen 3/3.5/3.6、GLM 5.1 、Gemma4 等 11+ 前沿大模型

- 多模态模型:PaddleOCR、CosyVoice、Wan 2.2、Flux 2 等图像和语音类模型

为什么无界模型云这么便宜

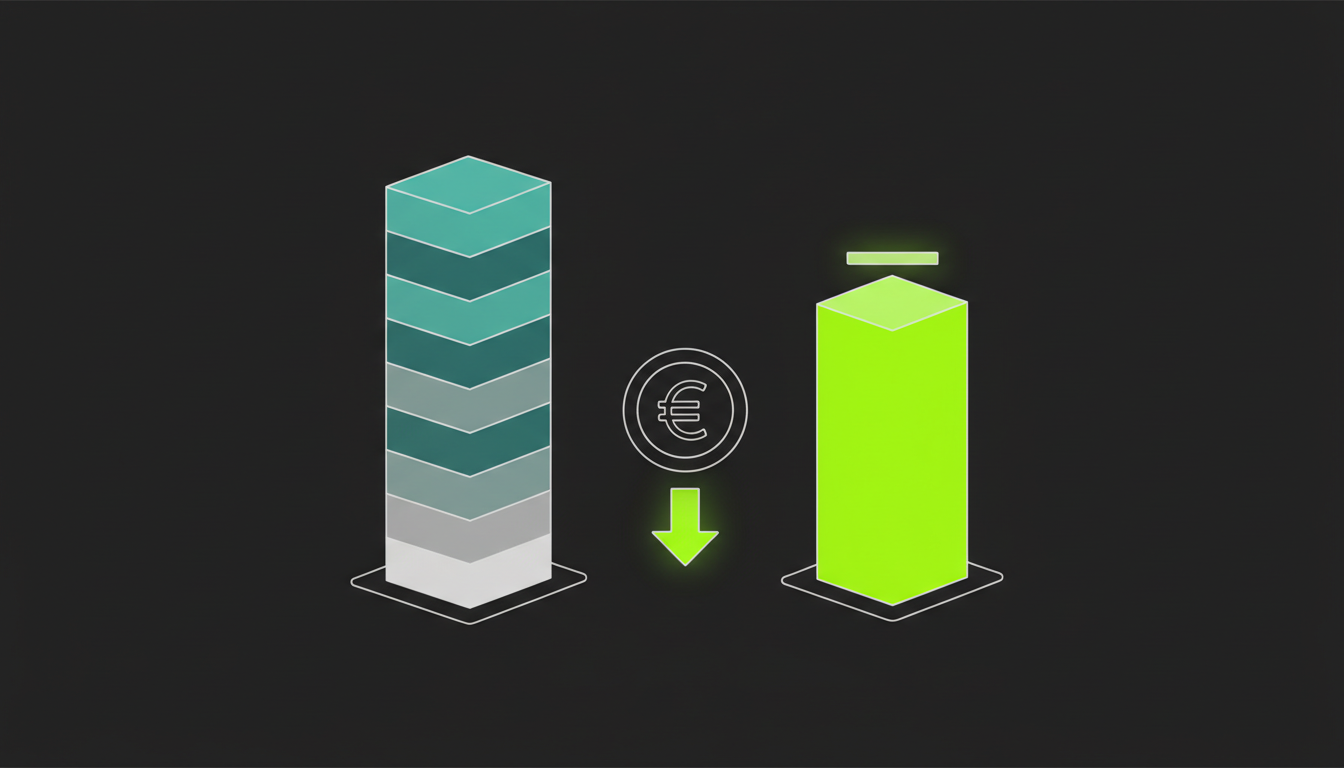

第一板斧:不做中间商,只收 5% 运营服务费

大多数模型云厂商的商业模式是"低价集采 + 加价卖出"。中间这一截加价,往往是 50%以上。

无界模型云以词元普惠为使命,我们不持有算力、不转租GPU,而是通过算力池化和推理引擎技术,把算力直接转换成Token。向接入的算力中心收 5% 的运营服务费,剩下 95% 的收入归算力中心。

调用方的价格直接由算力中心和无界模型云商定,必然低于云厂商价格,平台不在中间加一层毛利,不会被二道贩子截走,也不会被云厂商垄断收益。

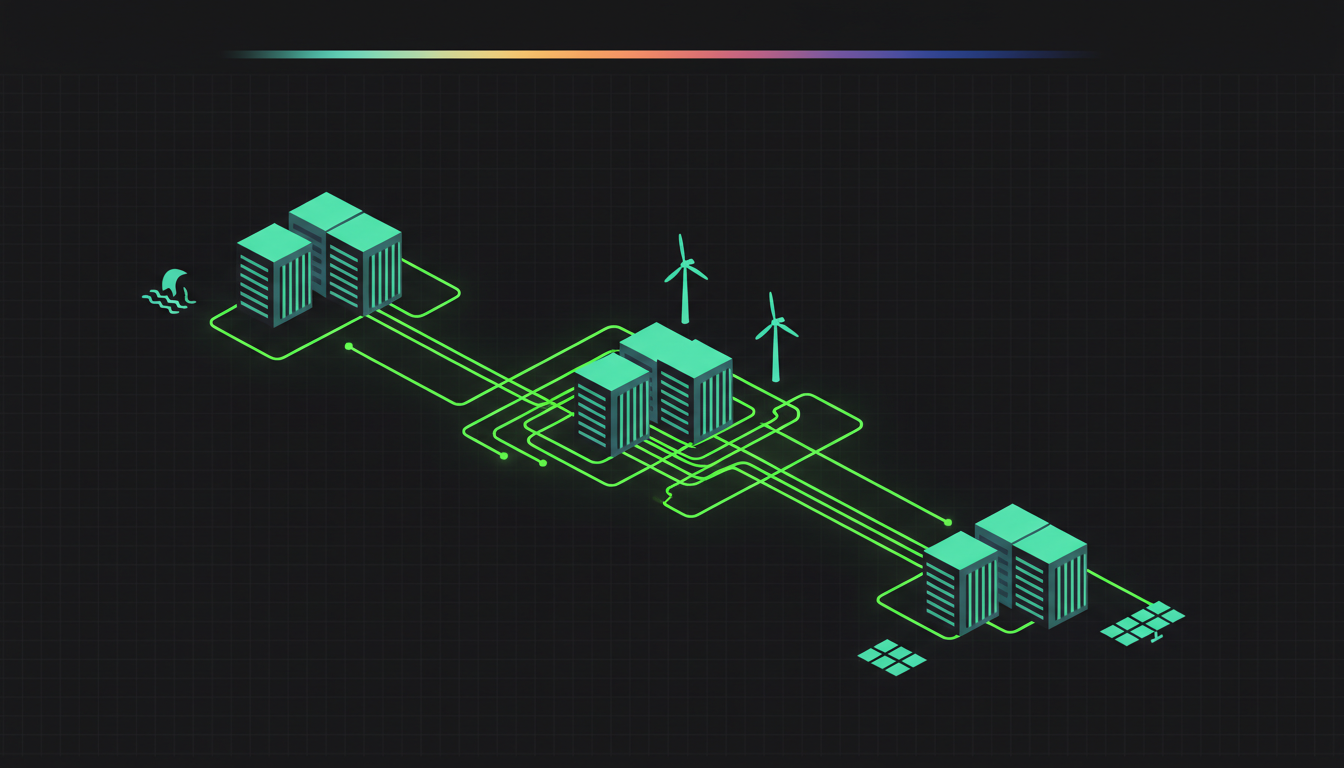

第二板斧:把分布式算力网络的闲置盘活

只砍掉加价还不够便宜,算力本身也有大量调度优化的空间。

国内不少 IDC、私有云、行业算力中心手里都有 GPU,但利用率长期只有 30% 左右——白天业务高峰挤破头,夜里整机房在空转。电费照交,卡的折旧照扣。

无界模型云把这些算力中心接成一张网,做两件事:

- 词元出海:开拓欧美和东南亚市场,为国际用户提供高性价比的Token,解决国内夜间空转问题,增加运营收益

- 算电协同:部分成本敏感的请求和非实时任务,可设置低成本优先策略,平台把这些负载调度到水电、风电、光伏等低价电力区域;

- 闲时任务填充:低峰期自动填入可延迟的批处理任务(离线数据清洗、批量召回、长文档解析等等),让 GPU 永不空转,平均利用率推到 90% 以上

对算力中心来说,利用率从 30% 拉到 90% 相当于月均收益翻 3 倍;对调用方来说,这部分成本节省直接体现在 Token 单价上。

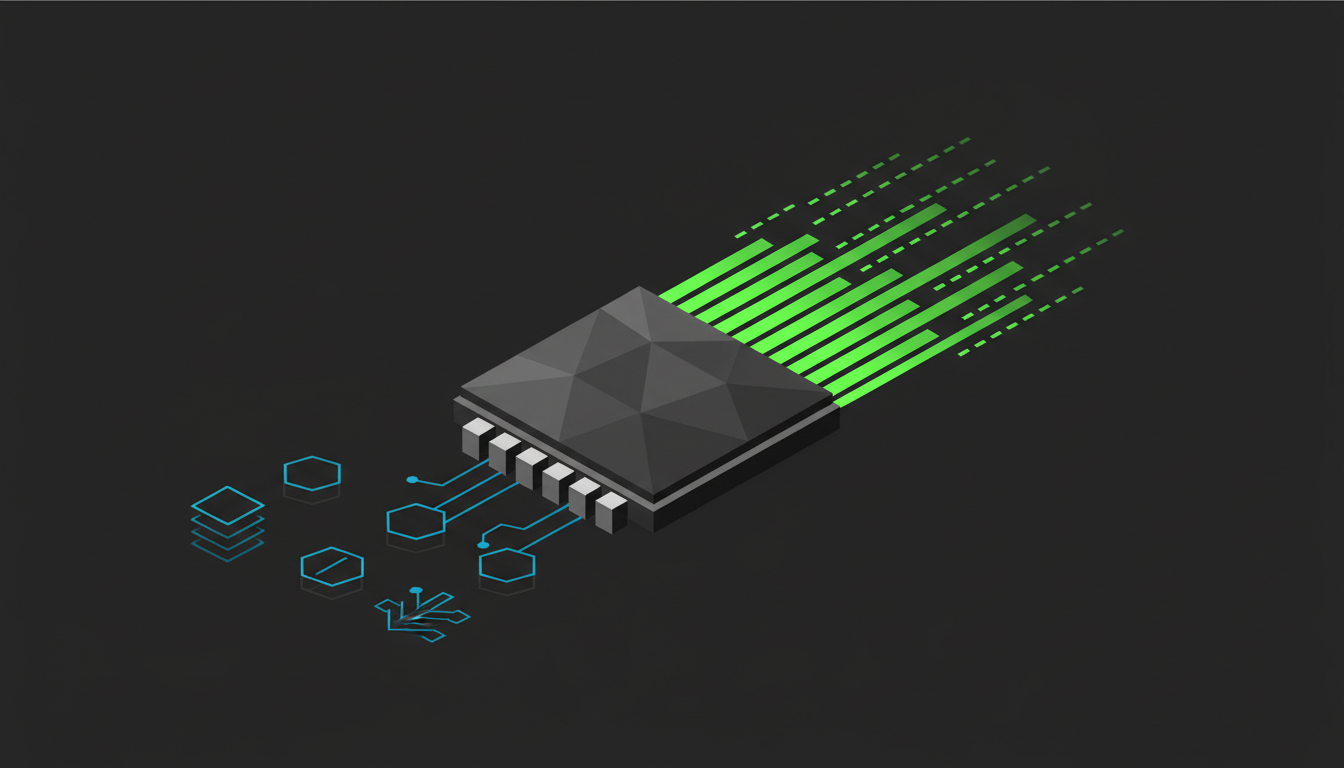

第三板斧:自研推理引擎,把每张卡榨干

同一批 GPU,能跑出多少 Token,差距可以很大。

无界模型云底层跑的是自研的大模型推理优化引擎,几件事是硬做的:

- 动态批处理:实时合并多请求,把 GPU 并行度推到最大

- KV Cache 池化:多轮对话的缓存跨节点复用,显存浪费降掉七成左右

- 算子融合:针对热点路径写定制 CUDA kernel,性能往理论极限逼

- 按模型和硬件做定制优化:同一个模型上 H100、A100、国产卡,编译、并行策略、调度参数都不一样——引擎会根据模型结构和硬件特性自动挑最优组合,不是一套配置跑到黑

这套引擎让同一张卡的吞吐比通用部署方式提升 3–5 倍,平均 TTFT 压到 80ms 以内,P99 也能卡在 1秒以下。卡没变多,Token 产出翻了好几倍,成本自然继续往下降。

产品能力一览

更便宜只是第一步,企业规模化用得住,还要把治理、合规、弹性都做到位。无界模型云把下面这些问题一次解决:

- 接入难:兼容多种厂商规范的API格式,改一行

baseURL就能迁,不需要重写业务代码 - 模型选型反复跳:11+ 主流大模型 + 多模态模型同一入口,后台可热切换,不用改代码就能换模型

- 多团队管不住:多租户后台按部门、项目分配额度,独立 API Key,用量、延迟、成本按业务线实时拆

- 合规过不去:敏感数据走AI网关的云边端协同路由,边缘侧完成推理不出域,调用日志全链路留痕可审计

- 高峰扛不住:算网智能路由选最优节点,秒级弹性扩缩,P99 TTFT < 100ms,SLA 做到 99.9%

- 复杂任务用不上:Function Calling、Batch API、结构化输出、长上下文对话的 KV Cache 复用都在

算力普惠,不是补贴出来的

让企业 AI 真正大规模用起来的前提,是 Token 价格足够低。

无界模型云选了一条不靠补贴的路:把中间商这一截砍掉,把分布式算力网络里的闲置和电价差盘活,再让自研引擎把每张卡多吐出几倍 Token。

三板斧落下来,让算力中心拿到九成五的收入,还能把 Token 单价做到比大型云厂商更低。

算力普惠不是口号,而是一笔每天都要算的账。

产品入口